A Inteligência Artificial revolucionou o desenvolvimento de software desde a chegada do ChatGPT. Efetivamente, programadores experientes e novatos adotaram ferramentas que permitem gerar código a partir de linguagem natural. O fenómeno, apelidado de Vibe Coding, permite que quase qualquer pessoa crie uma app funcional num ápice, mesmo sem saber escrever uma única linha de código. Desta forma, embora a ideia de democratizar a criação de software seja fascinante, há um lado negro que não pode ser ignorado. Neste cenário, estamos a assistir ao que pode ser o início de uma apocalipse de hacking alimentada por IA. Uma nova investigação da empresa de cibersegurança RedAccess revelou falhas de privacidade massivas em aplicações criadas através deste método. Na Leak.pt, analisámos os riscos de confiar cegamente no código gerado por máquina e o grande perigo do Vibe Coding.

Perigo do Vibe Coding: 40% das Apps Analisadas Expõem Dados Sensíveis

Para começar, a dimensão do problema é assustadora. A RedAccess examinou milhares de aplicações web criadas em plataformas populares de vibe coding como Lovable, Replit, Base44 e Netlify. O que encontraram foi, no mínimo, alarmante: cerca de 5.000 aplicações não tinham praticamente qualquer tipo de segurança ou autenticação.

Define a Leak como fonte favorita na Pesquisa Google e recebe mais notícias nossas.

Pior ainda, 40% destas apps expunham diretamente dados sensíveis dos utilizadores. Efetivamente, estamos a falar de informações médicas, registos financeiros, documentos corporativos confidenciais e até históricos de conversas privadas com chatbots que deveriam estar protegidos.

“O resultado final é que as organizações estão realmente a vazar dados privados através de aplicações de vibe coding”, explicou Dor Zvi, cofundador da RedAccess, à Wired. “Este é um dos maiores eventos de sempre onde as pessoas estão a expor informações corporativas ou sensíveis a qualquer pessoa no mundo.”

A IA não é um Especialista em Segurança

A resposta das plataformas de vibe coding às revelações foi desapontante. Enquanto a Netlify ignorou as conclusões, outras plataformas sacudiram a água do capote, culpando os utilizadores por não garantirem a segurança das suas próprias criações.

“O Lovable dá aos construtores as ferramentas para construir com segurança, mas a forma como uma app é configurada é, em última análise, responsabilidade do criador”, afirmou um porta-voz da empresa. No entanto, há aqui uma contradição óbvia. Estas mesmas empresas vendem a ideia de que criar software é agora tão simples como descrevê-lo a um bot.

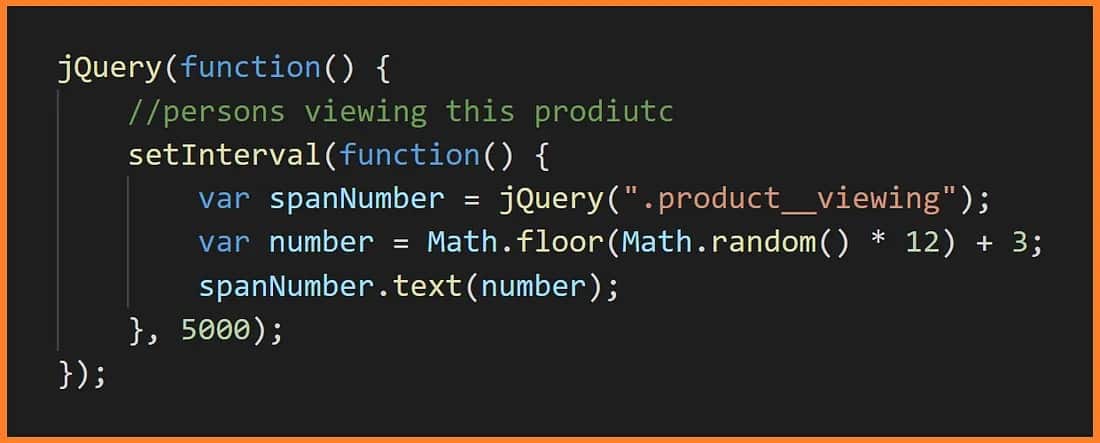

Por conseguinte, a realidade é que a IA continua a ser imperfeita. O código resultante contém frequentemente erros e vulnerabilidades que apenas um programador humano experiente ou um especialista em segurança conseguiria identificar. Ao ignorar o ciclo de desenvolvimento tradicional e os testes de segurança, estas apps entram em produção sem qualquer filtro.

Facilidade não Substitui Segurança

O vibe coding é uma ferramenta poderosa, mas extremamente perigosa se usada de forma negligente. Portanto, o facto de qualquer pessoa numa empresa poder gerar uma app e começar a usá-la com dados reais sem passar por uma auditoria técnica é um convite aberto para ataques cibernéticos.

Assim deixamos o alerta: a IA pode escrever código, mas ainda não consegue substituir o discernimento humano na proteção da privacidade. Afinal de contas, se decidires aventurar-te a criar uma app por IA, põe-te fino e certifica-te de que a segurança não ficou esquecida nas “boas vibrações”.

Achas que a facilidade de criar apps justifica estes riscos de segurança ou deveriam existir mais travões nestas plataformas?